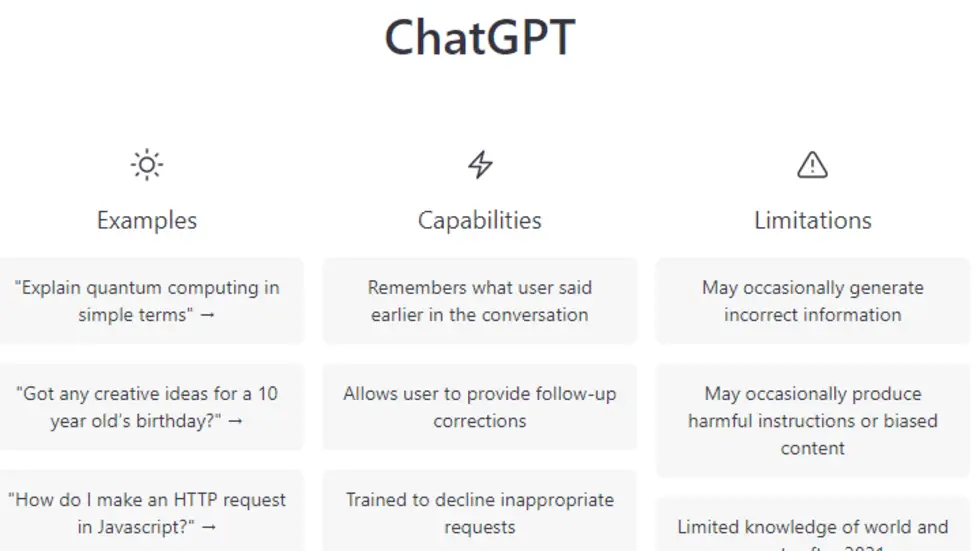

L’intelligence artificielle (IA) est en train de changer radicalement de nombreux métiers et secteurs. Une IA récente appelée GPT 3, développée par OpenAI, est capable d’interagir avec les humains grâce à une immense base de données accumulée. Elle peut répondre à des questions, écrire des articles, des vidéos ou des dissertations sur divers sujets, et même maintenir une conversation sur une interface appelée “tchat GPT”. GPT 3 peut se baser sur les conversations passées pour proposer des adaptations.

Bien que GPT 3 ne soit pas connectée à Internet, elle a assimilé une quantité énorme de connaissances, équivalente à 0,6% de tout Wikipédia. Ces avancées technologiques suscitent des débats sur l’utilisation de l’IA dans le domaine de la psychothérapie. Des thérapies en ligne sont déjà disponibles avec un thérapeute virtuel disponible 24h/24 et 7j/7 moyennant un abonnement mensuel. Il est également envisageable de choisir le style de thérapie et la personnalité du “thérapeute virtuel” grâce à l’IA. De plus, l’IA accumule une expérience d’interaction avec les patients, ce qui n’est pas possible pour un être humain.

Ces avancées nous amènent à nous demander si nous aurons bientôt plus confiance en les machines qu’en les êtres humains pour prendre des décisions cruciales, notamment dans le domaine médical. Les robots chirurgiens, qui ont un taux de réussite de 99%, sont comparés aux chirurgiens humains dont le taux de réussite peut être inférieur, ce qui illustre cette transition. De plus, si l’IA peut être associée à des avatars virtuels capables d’exprimer des émotions humaines, la frontière entre humains et machines devient floue.

Bien que ces avancées soient encore exceptionnelles et ne soient pas généralisées, elles soulèvent des questions éthiques et sociétales sur l’avenir de l’IA et son impact sur différents domaines de notre vie.

Source : Julien Besse | Date : 2023-01-15 11:00:17 | Durée : 00:12:18

Abonnez vous a Chat GPT

Abonnez vous a Chat GPT

Comments

Assez paradoxal le fait que la philosophie soit un métier d'avenir dans un monde qui tente de réfléchir de moins en moins par lui même 🤔

Pourquoi mon commentaire à été supprimé?

Je reste poli et transmets mon expérience de cette application tout en donnant mon analyse?!

Qu'est ce que vous êtes charmant á expliquer bien les choses!

Puisque c'est une intelligence artificielle elle réussira à se déprogrammer.

Merci Julien pour cette vidéo, encore une fois très intéressante ! Dans un monde dans lequel bcp de personnes souffrent de l’isolement tout en étant comme tu le disais, paradoxalement, presque prisonniers de la vie virtuelle, le développement de l’intelligence artificielle est effrayant notamment dans le cadre de la thérapie. Certes fiable, mais tellement déshumanisée, l’intelligence artificielle ne permettra pas cependant de remplacer l’accueil chaleureux du cabinet d’un psychologue et isolera encore un peu plus ceux qui le sont déjà. Après effectivement, si ça devient la norme, les générations futures pourraient vite s’y adapter et ça pose question. Où est l’humanité dans tout ça ?

Il n'est pas vrai que chatGPT incorpore dans son contexte toutes les discussions précédentes. Il a une mémoire limitée à un certain nombre de requêtes dans une seule discussion. Dommage que cette vidéo verse dans un transhumanisme délirant sans aborder les conséquences négatives de l'utilisation de ce type de logiciel, par exemple pour les écoliers et les étudiants. S'il y a un seul domaine où les humains ne seront pas remplacés par des machines, c'est bien celui de la relation soignante. La naïveté de ceux qui croient réellement qu'un modèle probabiliste de génération de texte pourrait produire autre chose que des réponses moyennes et s'adapter aux singularités irrationnelles de l'esprit humain nous indique une régression éthique gravissime. Les êtres humains ne pourront jamais retrouver leur âme, s'ils la recherchent dans une machine.

Je trouve que certaines choses que tu dis n'ont pas trop de sens par exemple tu dis que les IA sont programmer à avoir une éthique contrairement aux humains mais pourtant l'humain est aussi programmer à avoir une éthique, … Etc on est le produit de son époque si tu étais né au Moyen Age tu serais une tout autre personne avec des valeur probablement bien différent de ceux que tu as aujourd'hui. La singularité humaine n'est pas aussi importante qu'on croit il y a peu de choses qui nous différencie de l'IA en terme de raisonnement nous aussi nous agissons selon un script bien défini l'éducation nationale, .. Etc à ton avis ça sert à quoi ? à reconfigurer ton cerveau (de la programmation comme pour les IA)

Pour plus d'info sur les ia je vous conseille la serie de videos "intelligence artificielle" de science4all.

Et pour les question ethiques/philosophique la chaine de monsieur Phi.

Encore une propagande transhumaniste qui faisant semblant de poser la problématique sur un plan éthique et donc critique, pose la souffrance humaine en des termes d’emblée pipées, en donnant une solution algorithmique qui n'a que pour fin que d'entretenir cette souffrance indéfiniment. Exemple dans la vidéo : Constatant l'insistance d'immédiateté de nos besoins (ce qui est déjà souffrance), la solution proposer, n'est pas d'interroger cette insistance, cette souffrance, mais n'en faisant pas la base du problème et ne la traitant pas, de répondre non pas donc au fond de la demande, mais à la forme qu’elle prendra pour l'IA qui dans le fait même d'y répondre, pourra répondre à tout, et de tout, pour toute les formes, mais aucunement sur le fond de chacune d'entre elles. Et nous avons la preuve de cette néfaste propagande, quand à la fin de la vidéo, là encore tout en mimant un questionnement éthique sur la faisabilité d'un remplacement d'un psychothérapeute par une IA, l'auteur énonce par le truchement métaphorique de son tramway, l'assurance d'une erreur éthique moindre pour l’IA que pour l''homme, présageant qu'à défaut de nous remplacer pleinement, l'IA (Alimentée entre autre par Wikipédia comme il est précisé, sans préciser toutefois les conneries que trimbale aussi ce corpus) pourrait bien prochainement devenir très certainement nos prochains superviseur. Si ce type de propagande, jouant sur l'inversion d'un message apparemment critique ne se multiplier pas, cela pourrait prêter à rire…Malheureusement, tel n'est pas le cas…

Bonsoir et merci pour cette nouvelle vidéo. Ce que je trouve dangereux c'est que plus la technologie apprend à faire à la place de l'humain et plus l'humain désapprend…et nous avons déjà un pied dans "l'idiocracy" en référence au film de Luke Wilson…vous évoquez la question de l'éthique…le soucis est bien là…dans les systèmes dans lesquels nous vivons les valeurs qui motivent les actions sont très discutables, si toutefois on peut parler de valeurs…il y aurait encore beaucoup à dire mais je m'arrête là…"que sera sera".

Pas idiot l'idée d'une supervision avec une IA, si ça ne finit pas de vous embrouiller la tête…:)) Mais de grâce, julien, ne vous faites pas cloner cybernétiquement!

Parce que les charlatans psychiatres des hôpitaux eux ont des émotions pt être ?ils ont de l empathie ?nn plus ils cherchent juste à faire gagner de l argent aux laboratoires pharmaceutiques dc autant avoir une ia😡

Les hommes commencent tous juste à comprendre que nous faisons du mal à la planète avec nos activités qui vont à l'encontre de la nature et de notre nature. Dans 50 ou 100 ans, nous nous rendrons compte aussi que la technologie ce n'est pas la vie et apprendrons peut-être à vivre plus raisonnablement avec. Aujourd'hui, on est loin de ça et plus nous sommes technologiquement avancés, plus nous sommes surmenés et plus il y a des soucis de santé mentale. Donc l'IA aussi incroyable soit t'elle, n'est pas près de faire disparaître les thérapeutes. Et puis entre être humain il y a plein d'échange que l'on appelle "énergétique" sans vraiment le comprendre, mais qui sont hyper important et encore plus dans la thérapie.

Très bonne vidéo merci. C'est justement parce que la relation humaine est imparfaite, imprévisible, etc que la relation transférentielle peut se déployer.

Un patient peut-il redouter les actes de rétorsion d'un robot? Peut-il s'en vouloir d'avoir dit/fait vivre quelque chose à une machine? Peut-il séduire un robot et fantasmer sa réaction comme dans une relation thérapeutique?

Il y aurait tant d'autres exemples…

En somme, et en des termes un peu schématiques, un patient peut-il être travaillé au niveau inconscient (par ses pulsions comme par son instance surmoïque) dans une "relation" avec une machine?

Cela me semble impossible, notamment parce que la machine on ne peut pas (et donc pas fantasmer) la rendre réellement amoureuse de nous, ni la faire réellement souffrir, ni la tuer ni lui faire l'amour…

Partant de là, cela me semble complètement illusoire d'espérer obtenir une parole véritable, des émotions.authentiques, des actes manqués, etc etc…

Et vous, qu’en pensez-vous ?