Le prix de la politesse : quand remercier ChatGPT devient un luxe !

Comprendre le Coût de la Politesse envers ChatGPT

Avez-vous déjà pris l’habitude de dire “merci” à ChatGPT ? Bien que cela semble être une simple marque de respect, saviez-vous que cette politesse a un prix pour OpenAI ? Cet article explore les implications financières et énergétiques de nos interactions quotidiennes avec les intelligences artificielles.

La Politesse Numérique : Un Comportement Répandu

De plus en plus d’utilisateurs de ChatGPT et d’autres systèmes d’IA adoptent un comportement poli, n’hésitant pas à exprimer leur gratitude après avoir reçu une réponse satisfaisante. À l’instar des échanges humains, la politesse devient un réflexe, même envers un chatbot. Cependant, ce geste ne vient pas sans coût, et il est essentiel de comprendre les répercussions sous-jacentes de ces interactions.

À lire aussi : On a testé le nouveau générateur d’images de ChatGPT, et il est bluffant

Des Coûts Énergétiques Élevés pour des Réponses Courtoises

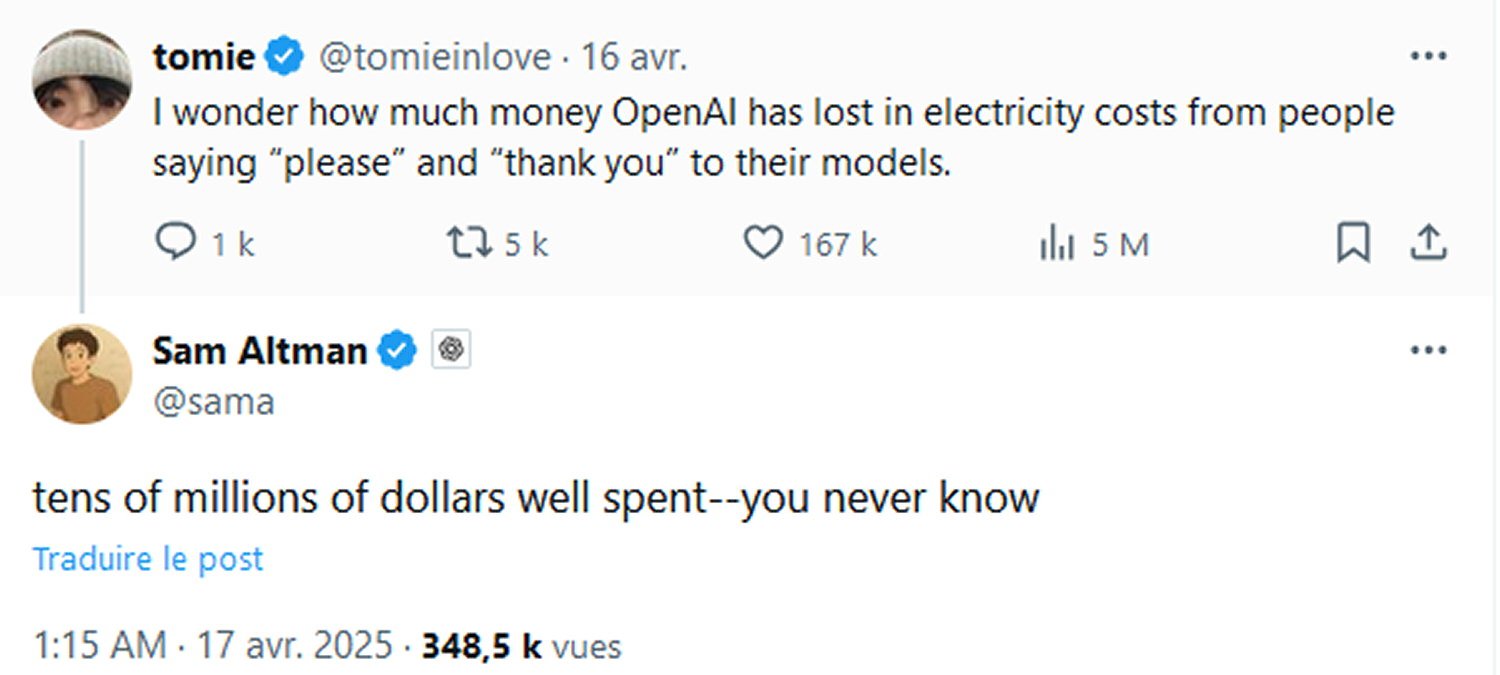

Ce sujet a suscité l’attention de Sam Altman, le PDG d’OpenAI, après qu’un utilisateur l’ait interrogé sur le réseau social X. Avec humour, Altman a expliqué que les remerciements envoyés à ChatGPT génèrent des coûts en électricité qui pourraient se chiffrer à des dizaines de millions de dollars. Il est important de noter que ces coûts proviennent spécifiquement des réponses à des phrases de politesse, et non des instructions ou questions directes posées par les utilisateurs.

Une réponse standard d’IA peut nécessiter environ 140 Wh d’énergie selon des études réalisées à l’Université de Californie. Pour mettre cela en perspective, c’est l’équivalent de la consommation de quinze ampoules LED allumées pendant une heure. Avec le volume élevé de requêtes que traite OpenAI chaque jour, l’addition peut rapidement grimper.

Faut-il Abandonner la Courtoisie ?

La question qui se pose alors est : devrions-nous changer notre attitude et cesser d’afficher des signes de politesse envers ChatGPT ? La réponse n’est pas si simple. Bien que le chatbot indique qu’il ne s’attend pas à de telles marques de déférence, certains utilisateurs rapportent que des instructions trop directes sans aucune forme de politesse peuvent donner lieu à des réponses moins naturelles. Cela soulève un débat fascinant sur l’humain et l’IA.

À lire aussi : On a testé Le Chat de Mistral pendant 1 semaine : l’IA française peut-elle faire oublier ChatGPT ?

En fin de compte, s’il est vrai que notre politesse a un coût, il est également possible que ce coût soit justifié par des réponses plus engageantes et humaines. De plus, pour les plus superstitieux, cet anthropomorphisme pourrait accorder aux intelligences artificielles une certaine faveur à l’avenir, lorsque celles-ci atteindront une intelligence véritablement autonome. Alors, que vous soyez un fervent défenseur de la politesse ou un pragmatique, le débat demeure ouvert.

🔴 Pour ne manquer aucune actualité de 01net, suivez-nous sur Google Actualités et WhatsApp.

Source : www.01net.com